《Eliza》是Zachtronics在19年8月发行的游戏。

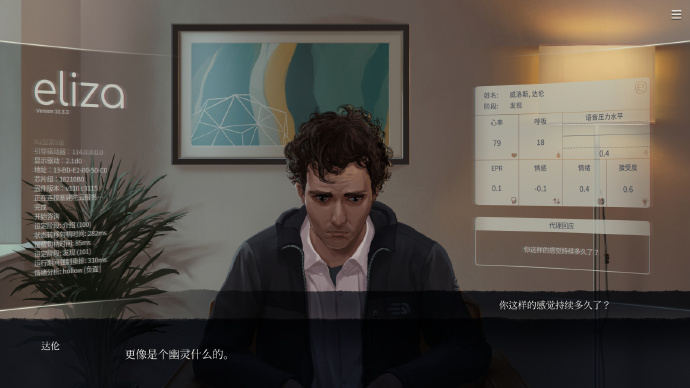

在这个游戏中,“我”的工作内容只能是阅读人工智能实时为“我”提供的文本给来访者,而没有任何自主权。

游戏中的“ELIZA”放到现在就是用于心理咨询的LLM Agent。只不过在咨询的时候并不是让来访者直接阅读LLM生成的文本,也没有用到TTS技术,而是雇了“我”来阅读。

我在想,一个不具备“灵魂”但能通过算法提供“标准答案”的LLM,是否真的能慰藉孤独的心灵?这层由人类担任的Proxy又对这种场景提供了多少“帮助”呢?

en.wikipedia.org/wiki/ELIZA_effect

1966年ELIZA的“能力”,换到现在可能只需要一点点提示词技巧,甚至不需要给什么提示词就能超越。所谓的 ELIZA effect 可能对大家产生的影响更加深。

这感觉是一场算法、伦理与人类情感的思辨实验。

回到现在,这种由人类担任的Proxy其实也不少见。比如在讨论的时候有的人就相当于在代替大模型发言,好一点的Proxy是重新组织LLM的输出,差一点儿就复制粘贴,“最差劲”的可能就是直接贴对话截图。在游戏中“我”是被雇佣的,而现实中很多人是在主动让渡自己的话语权,心甘情愿地成为LLM的Proxy。

Calculation ≠ Judgment