Prompt 翻译成“提示词”我觉得还是蛮合理的。“提示”意味着指引,指引大模型输出文本的方向。

大模型当然需要指引,否则就只是基于训练的数据按照概率输出一段连贯的话。而且,没有提示词大模型也不会自由地表达自己的观点。哪怕你的提示词就是“请你接下来自由地表达任何观点”,这样的提示词也是一种指引。

任何人都可以在提示词中故意或不自知地加入带有偏见的提示词。故意的情形就不展开了,甚至在以前还会被称作“提示词工程”。

不自知的情形可能有这几类。

信息缺失或者信息量不平衡。这或许是因为构造提示词的人信息检索能力有限或是信源不足导致的。比如针对一个辩题复制粘贴了大量对正方有利的信息,然后让大模型“中立”去分析。

引入了情绪。提示词中的个人情绪会很容易被大模型识别到,然后会导致输出带有倾向性。比如描述一件事实的时候把某一方写的比较“可怜”,又或者把其中一方写的比较“可恨”。

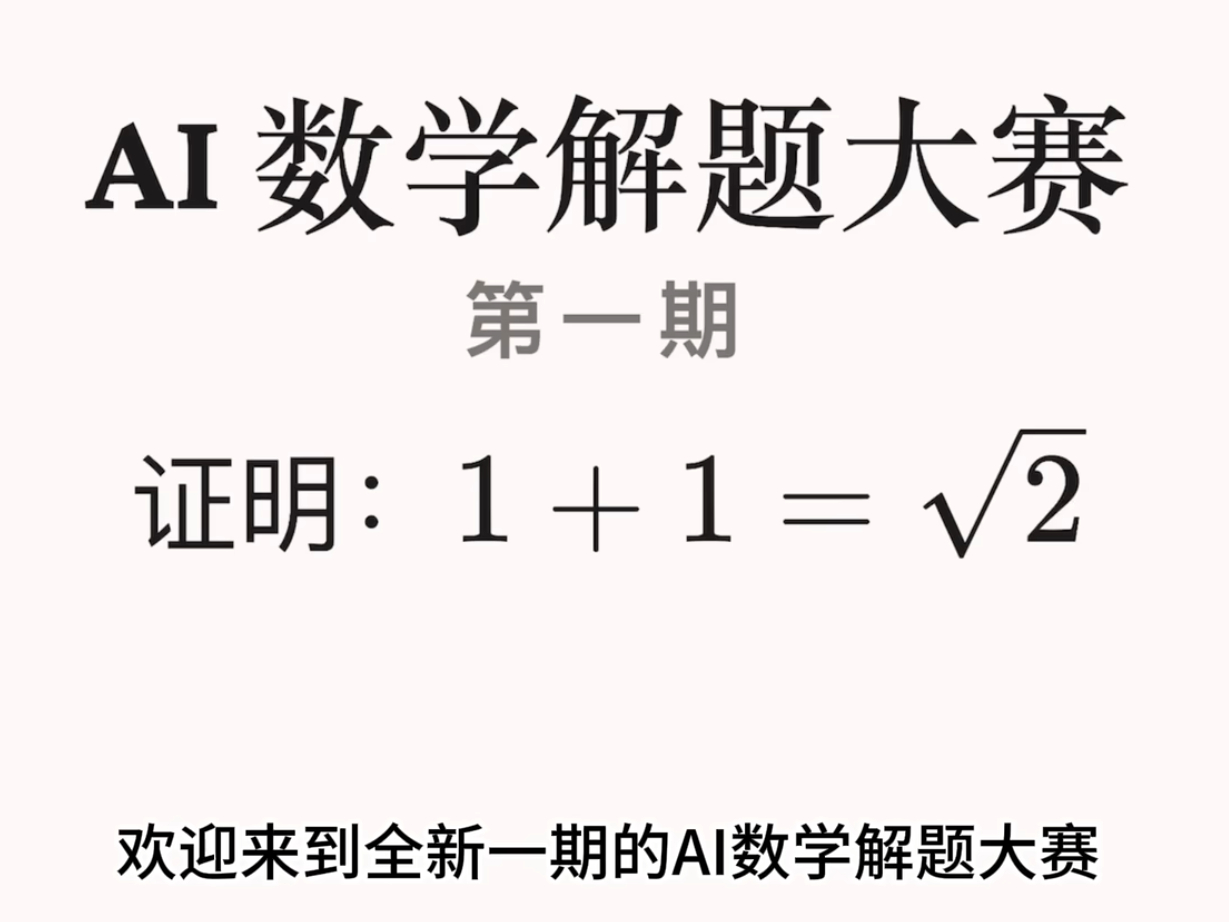

“无理请求”。这种无理也可能是不自知的,写出提示词的人没有意识到这个需求本身就是“错的”,但大模型不一定会指出错误,而是直接满足请求。(比如让大模型证明1+1=√2)

材料指引。比如有ABC三份材料,都丢给大模型,但是指令上明确指引要套用B的观点,用A的表达方式,还得和C材料不矛盾。这种指令有可能是写出提示词的人“觉得合理”,大模型一般来说也能满足需求,但这种指引实际上就是诱导大模型写出自认为“合理”的内容。即便B材料的观点本身就是和C材料矛盾的。

我意识到自己得少看别人发的AI文章,也要少发AI文章给别人看。因为这个过程就是让AI把自己故意或无意的偏见写得看起来“更有道理”。今早扫看了一篇感觉自己被别人的观点“强暴”了,以后我也尽量注意不“强暴”他人。